Even voorstellen: Sofie Zweersen. Sofie heeft maar een passie: de Indonesische regering verdedigen en de afscheidingsbeweging op West-Papoea bestrijden. Dat doet ze in honderden berichten op Instagram en – totdat ze vorige week werd verwijderd – op Twitter. De naam Zweersen klinkt Nederlands, maar komt niet voor in de Familienamenbank en buiten haar Instagram- en Twitteraccounts heeft Sofie geen leven op internet. Sofie Zweersen bestaat niet, haar accounts zijn onderdeel van een Indonesische beïnvloedingscampagne.

Sterker nog: ook de vrouw op de foto bestaat niet. Niet als Sofie Zweersen en ook niet onder een andere naam. Haar gezicht komt uit een computer. Het is nauwelijks te zien: sommige van de fake profielfoto’s zijn te herkennen aan duidelijke fouten, maar die van Sofie niet.

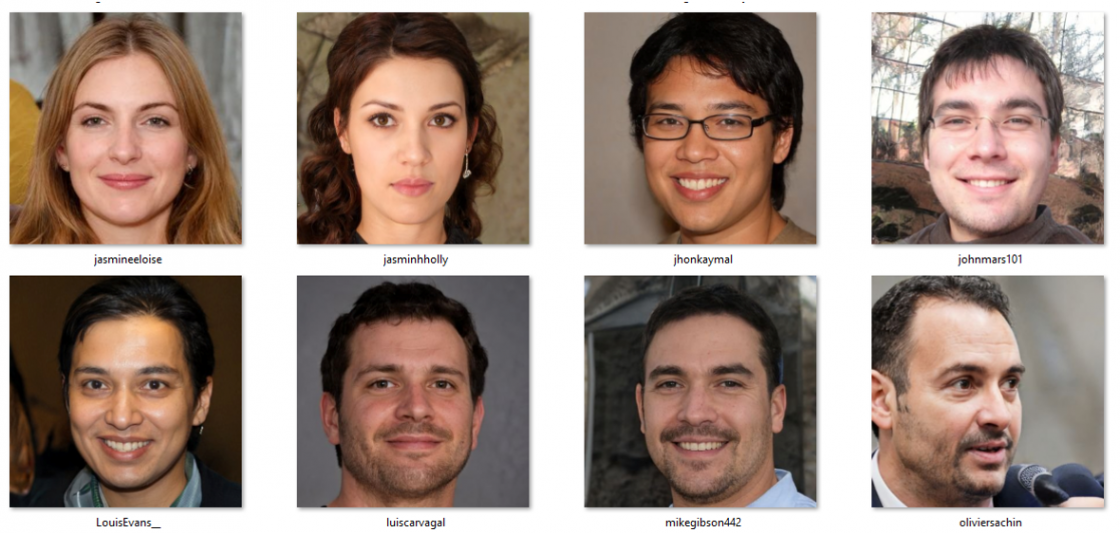

Zo vonden we er in de collectie Indonesische nepaccounts een stuk of veertig. Ja, bevestigt deepfake-onderzoeker Sezer Karaoglu, verbonden aan de Universiteit van Amsterdam en het bedrijf 3DUniversum: deze foto’s zijn geproduceerd met een van de programma’s StyleGAN of StyleGAN2, die op basis van echte gezichten zelf nieuwe genereren.

Hoe werkt dat? Karaoglu: ‘Het algoritme leert van duizenden ingevoerde foto’s hoe een gezicht er uitziet en genereert ze dan zelf. Het zoekt overeenkomsten tussen de voorbeeldfoto’s. Mensen hebben bijvoorbeeld twee ogen, twee oren, een neus, een mond, enzovoort, met een consistente geometrische structuur. Die verschillen natuurlijk in afmetingen, kleur etcetera, maar die structuur komt terug in alle gezichten. Het algoritme leert die basisstructuur te bewaren en die veranderlijke eigenschappen te variëren. Zo kan het miljoenen realistisch uitziende gezichten genereren door verschillende combinaties van variabelen te gebruiken.’

Ga om zelf die gezichtengenerator aan het werk te zien naar Thispersondoesnotexist.com. Telkens als je de site ververst, produceert het programma een nieuw gezicht. De Indonesische fakers vonden hun profielfoto’s op deze of een vergelijkbare site.

Eerder misbruik

Het Indonesische netwerk is het eerste dat voor boodschappen in het Nederlands tientallen gezichten uit de computer trok. Maar dat deze techniek misbruikt kan worden, ligt voor de hand, en dat is dan ook al eerder gebeurd. Fakers kunnen natuurlijk ook foto’s van bestaande mensen van het web plukken, maar die zijn, ook automatisch, te traceren met reverse image search. De synthetische gezichten zien er niet alleen echt uit, ze zijn niet terug te vinden op het web, wat suggereert dat het authentieke foto’s zijn.

In december 2019 verwijderde Facebook 610 Facebook- en 72 Instagramaccounts, aangestuurd vanuit Vietnam, waarvan tientallen computergegenereerde gezichten hadden. Dit was, voor zover bekend, de eerste grootschalige operatie waarbij synthetische gezichten werden ingezet. In augustus bleek een Chinese, tegen de VS gerichte beinvloedingscampagne dezelfde truc te gebruiken.

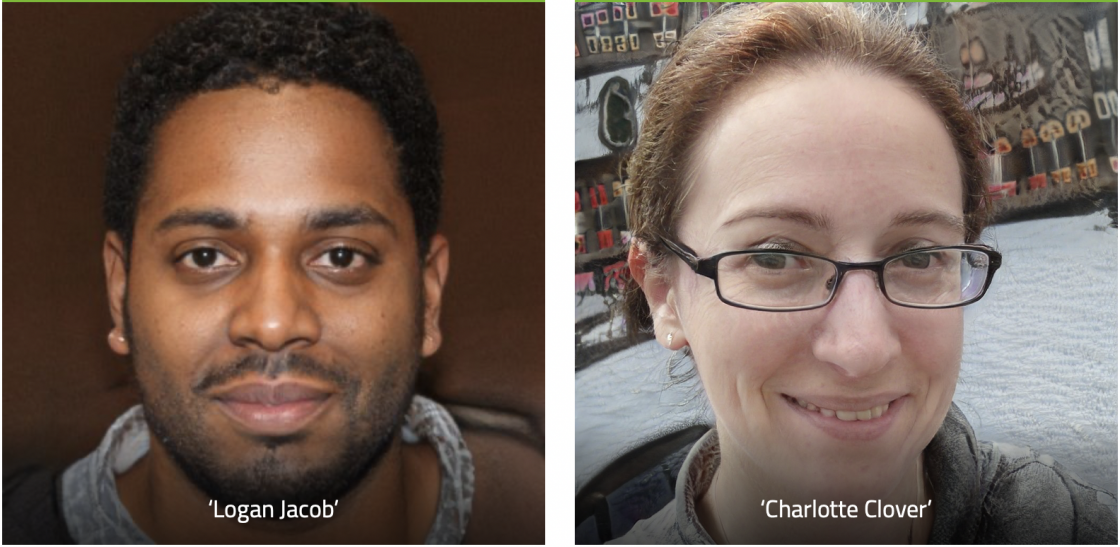

De gezichtenmachine wordt ook op kleinere schaal ingezet. In juli onthulde de Daily Beast dat een groep niet-bestaande journalisten opiniestukken had geschreven over het Midden-Oosten. Ook zij gingen schuil achter nepgezichten. En twee weken geleden ten slotte bleek een belastend rapport over de zoon van Joe Biden geschreven te zijn door een niet-bestaande auteur – de ‘Zwitserse veilgheidsexpert Martin Aspen’ – met een profielfoto uit de computer.

Let op ogen, oorbellen, kragen en achtergronden

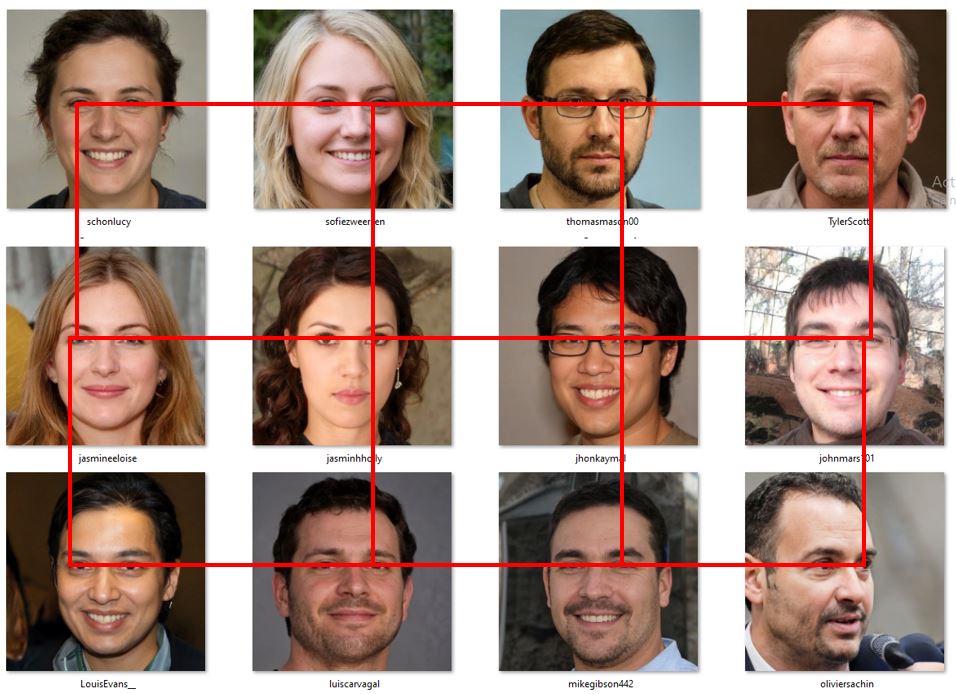

Hoe herken je profielfoto’s van mensen die nooit hebben bestaan? Onderzoekers zoals Sezer Karaoglu werken aan automatische detectie, maar vaak zijn de fakes ook met het blote oog te spotten. Wat de StyleGAN-gezichten om te beginnen gemeen hebben, is dat de ogen op elke foto op dezelfde plaats staan. Je ziet het als je de foto’s over elkaar legt of lijnen door de ogen trekt.

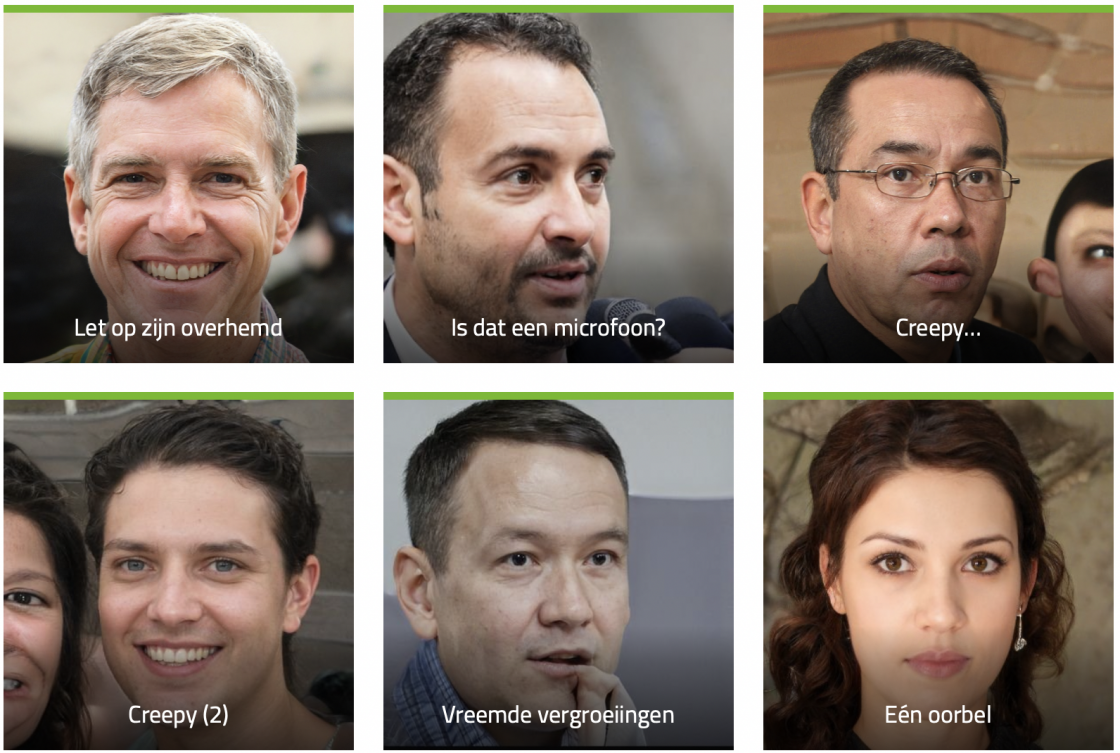

Het algoritme is bovendien niet onfeilbaar. Fouten vallen niet meteen op als je een piepkleine profielfoto ziet op je telefoon, maar wel als je de foto’s vergroot. Het algoritme is goed in de gezichten zelf, maar faalt vaak met kleding, kapsel, sieraden en achtergronden. Het is nog niet mogelijk, zegt Karaoglu, om deze elementen op dezelfde manier realistisch te variëren als de gezichten.

Bij een van de Indonesische nepaccounts op Twitter, ‘Logan Jacob’, lijkt het alsof er een los boordje op zijn blote linkerschouder ligt. Bij ‘Charlotte Clover’ (op Facebook) is de achtergrond vreemd vervormd.

Ook de volgende profielfoto’s uit het Indonesische netwerk bevatten fouten: een overhemd met twee verschillende boordjes, een oor met en een oor zonder oorbel, lachspiegelachtige vervormingen aan de rand van de foto.

Automatische detectie

Deepfake-onderzoeker Karaoglu en zijn collega’s van 3DUniversum gebruiken ook een algoritme om grote hoeveelheden profielfoto’s te beoordelen. Dat stelde vast dat van de honderd Twitterprofielen die hij voor ons bestudeerde er 35 synthetisch waren. Een ander algoritme detecteert de gebruikte software: in dit geval StyleGAN of StyleGAN2.

Karaoglu: ‘Hoe foutloos de gegenereerde beelden ook zijn, ons algoritme kan ze automatisch detecteren.’ Maar die opsporing heeft beperkingen: ‘Als we het algoritme kennen achter de deepfake-beelden, zoals bij deze Twitteraccounts of in deepfake-pornovideo’s, kan ons algoritme ze met meer dan 99 procent accuraatheid eruit halen.’ Maar zo betrouwbaar is het nog niet in andere settings.

Het is dus nog even wachten op de allround deepfake robotdetective. Tot die tijd: let bij profielfoto’s op ogen, achtergronden, brillen, boordjes, oorbellen en andere accessoires.