Beelden in dit artikel die nepbloed, nepverwondingen en ernstige uithongering tonen, kunnen als schokkend worden ervaren.

Dit onderzoek werd uitgevoerd door Nieuwscheckers en gecoördineerd door het Nederlands Instituut voor Beeld & Geluid in het kader van het onderzoeksproject ‘Factcheck Connect’, en is tot stand gekomen dankzij een subsidie van het Ministerie van Binnenlandse Zaken en Koninkrijksrelaties (BZK).

Op 28 februari vielen de Verenigde Staten en Israël Iran aan met raketten. Het was het begin van een oorlog die iets meer dan een maand zou duren, waarbij de Iraanse opperleider ayatollah Ali Khamenei en Mohammed Papkour, leider van de Iraanse Revolutionaire Garde, werden vermoord. Iran sloot als reactie de Straat van Hormuz, een zeeroute waar een vijfde van de olie die de wereld consumeert dagelijks doorheen wordt getransporteerd. Als gevolg stegen de olieprijzen in maart explosief. Op 8 april werd een wapenstilstand afgekondigd, maar Israël bleef het zuiden van Libanon aanvallen om de militante islamistische beweging en Iran-bondgenoot Hezbollah te verzwakken. Op 17 april werd daar ook een wapenstilstand afgekondigd en sinds de wapenstilstanden vinden er stroeve vredesonderhandelingen plaats tussen de Verenigde Staten en Iran. De wapenstilstand blijft precair: begin mei waren er kort weer raketaanvallen van Iran en de Verenigde Staten.

Deze oorlog tussen enerzijds de Verenigde Staten en Israël en anderzijds Iran en bondgenoten in de regio, zoals Hezbollah, is een voorbeeld van een wereldorde die het laatste decennium steeds instabieler wordt. De oorlog in Iran was een vervolg op een kortere, Twaalfdaagse Oorlog tussen Israël en Iran in juni 2025. In 2022 begon Rusland een invasie van Oekraïne, maar de basis was acht jaar eerder al gelegd: in 2014 annexeerde Rusland de Krim en daarna riepen delen van de oost-Oekraïense oblasten (provincies) Donetsk en Luhansk de onafhankelijkheid uit om zich bij Rusland te voegen. Tegelijkertijd dreigt Donald Trump sinds het begin van zijn tweede termijn als Amerikaans president om uit de NAVO te stappen en aast hij op Groenland. En sinds oktober 2023, toen de militante islamistische beweging Hamas een grootschalige aanval lanceerde op Israël, voert dat land een grootschalige oorlog in de Gazastrook.

“Het eerste dat in oorlog sterft, is de waarheid” is een gevleugelde uitspraak over dit soort conflicten die zelf vaak waar blijkt te zijn. Beide zijden in tijden van oorlog zetten grootschalig propaganda en desinformatie in om de vijand zwart te maken of de eigen strijdvaardigheid of overwinningen te benadrukken. Zo circuleert er online sinds het begin van de oorlog tussen Oekraïne en Rusland veel desinformatie over de Oekraïnse president Zelensky. Hij zou een multimiljardair zijn die vele huizen bezit, een verkapte nazi zijn of naar het buitenland gevlucht. Deze berichten zijn waarschijnlijk deel van een Russische desinformatiecampagne.

Dit soort desinformatie kan op meerdere manieren gemaakt worden. Bij het nepnieuws over Zelensky was vaak sprake van bewerkte of uit de context gehaalde beelden. Sinds een aantal jaar is het ook mogelijk om met kunstmatige intelligentie (AI) beelden en video’s te genereren. Bij de oorlog in Iran zagen we bijvoorbeeld dat Iran om het Amerikaanse publiek aan te spreken propagandavideo’s produceert met AI waarin Trump en andere Amerikaanse politici worden afgebeeld als lego-minifiguren of als animatiepersonages in de stijl van filmstudio Pixar. Trump wordt hierbij vaak in verband gebracht met de rijke zedendelinquent Jeffrey Epstein, de Israëlische premier Benjamin Netanyahu, antisemitische karikaturen van joden en algemeen geweld in de vorm van explosies en bloed.

Methode

Er lijken dus verschuivingen plaats te vinden op het gebied van nepbeelden over oorlog. In maart en begin april hebben we verschillende van die beelden over de oorlog in Iran gecheckt. We zijn op de website van Nieuwscheckers en in de factcheckdatabase van BENEDMO ook op zoek gegaan naar factchecks over beelden van recente oorlogen: de oorlog tussen Rusland en Oekraïne, de oorlog die Israël voert in Gaza en de twee oorlogen in Iran in 2025 en 2026. We hebben in de database gezocht op de termen “Oekraïne”, “Gaza”, “Palestina” en “Iran” vanaf de data dat iedere oorlog begon:

- Vanaf 24 februari 2022, toen Rusland Oekraïne binnenviel.

- Vanaf 7 oktober 2023, toen Hamas Israël aanviel en Israël de oorlog in Gaza begon.

- Vanaf 13 juni 2025, toen de Twaalfdaagse Oorlog in Iran begon (factchecks over de protesten van de Iraanse bevolking tegen het regime in december 2025 en januari 2026 hebben we hierbij buiten beschouwing gelaten).

We selecteerden op Nederlandstalige checks waarin de gecheckte beelden als (deels) onwaar zijn bestempeld; voor beelden die meer dan eens gecheckt zijn, namen we maar een factcheck op. Dit leverde 179 artikelen op die de oorsprong zochten van 255 beelden. Dat verschil ontstaat doordat sommige factchecks, vooral verzamelartikelen van de Vlaamse VRT, meerdere oorlogsbeelden behandelen of doordat video’s die gecheckt zijn meerdere fragmenten bevatten die op een verkeerde manier worden gepresenteerd of nep zijn.

Vervolgens hebben we de beelden ingedeeld op basis van hoe ze worden ingezet. In tegenstelling tot de vorige deep dives over migratie, klimaat en de lhbti+-gemeenschap is er bij oorlog vaak geen sprake van overkoepelende narratieven. Bij verschillende conflicten proberen de verscheidene facties zichzelf zo goed mogelijk en de vijand zo slecht mogelijk neer te zetten. Daarom focussen we in deze deep dive over oorlogsbeelden meer op de manieren waarop die nepbeelden tot stand komen.

We hebben de factchecks gesorteerd volgens een indeling van Michael Hameleers van de Universiteit van Amsterdam in een studie van de oorlogen in Oekraïne en Gaza [pdf]. Hameleers maakt in eerste instantie een onderscheid tussen beeld dat is gegenereerd of bewerkt met AI (ook wel deepfakes genoemd) en zogenaamde ‘cheapfakes’. Cheapfakes zijn echte beelden die uit hun context zijn gehaald of beelden die bewerkt zijn met middelen die minder geavanceerd zijn dan AI. Gedecontextualiseerde beelden verdeelt Hameleers in vier categorieën en daarnaast hebben we ook categorieën gedefinieerd die niet passen binnen die vierdeling:

- Temporele decontextualisatie: oude beelden waarvan wordt gedaan of ze van een recent conflict zijn. In onze indeling hebben we dit samengenomen met ruimtelijke decontextualisatie, omdat de twee in de praktijk vaak met elkaar samengaan.

- Ruimtelijke decontextualisatie: beelden waarvan wordt gedaan alsof ze van een conflict in een bepaalde regio zijn, maar die in werkelijkheid op een andere plaats genomen zijn. In onze indeling hebben we dit samengenomen met temporele decontextualisatie, omdat de twee in de praktijk vaak met elkaar samengaan.

- Fictieve decontextualisatie: beelden waarbij fictieve materialen worden gepresenteerd als authentieke beelden, vaak om te beweren dat echte gebeurtenissen in scène zijn gezet. Denk hierbij aan filmsets of beelden uit films, tv-series of videospelletjes.

- Actor decontextualisatie: beelden waarbij wordt gedaan alsof mensen op foto’s en in video’s die niets te maken hebben met een conflict slachtoffers, daders of partijdige supporters zijn in het conflict. Dit kan ook verwijzen naar experts die zogenaamd een kant in het conflict aanprijzen.

- Bewerkte beelden: beelden die met fotobewerkingssoftware als Photoshop bewerkt (lijken) te zijn.

- Enscenering: beelden die in scène gezet zijn.

- Misleidende tekst: beelden waarbij de decontextualisering puur voortkomt uit de begeleidende tekst, omdat de beelden op zich verder wel te maken hebben met de oorlog in kwestie.

Russisch-Oekraïense Oorlog

De oorlog in Oekraïne is ruim vier jaar bezig, waardoor deze oorlog van de drie waar we factchecks over verzameld hebben de meeste resultaten opleverde. Hier zien we ook de grootste variëteit in categorieën. We vonden 82 artikelen met in totaal 104 beelden. Factchecks over president Zelensky, waar we in 2025 een artikel over hebben gepubliceerd, laten we buiten beschouwing.

AI-gegenereerde beelden (13 beelden)

Bij de oorlog in Oekraïne vonden we relatief weinig beelden die gemaakt of bewerkt zijn met AI. De voorbeelden zijn sporadisch en vertolken diverse oorlogsnarratieven. In twee gevallen zijn foto’s van neergeschoten straaljagers vervalst, waarbij beide kanten van het conflict beweren vliegtuigen vernietigd te hebben, waarschijnlijk om hun eigen kracht te benadrukken.

In vier andere factchecks ligt de focus op Oekraïense soldaten. Een filmpje van een huilende 23-jarige soldaat onderweg naar het front blijkt deel van een heel genre van AI-gegenereerde video’s, en nepbeelden van een soldatengraf en een officieel document moeten bewijzen dat soldaten illegaal gemobiliseerd worden. De mobilisatieleeftijd in Oekraïne is namelijk 25 jaar. Zes andere nepfoto’s zijn uit op winstbejag: er wordt op Facebook nepnieuws verspreid over verwonde soldaten en huilende moeders met AI-beelden die veel weg hebben van typische, emotioneel manipulatieve AI-slop die op Facebook te vinden is.

Een AI-foto van een kind dat zijn huis zou zijn kwijtgeraakt door een Russische raket lijkt dan weer oorlogspropaganda te zijn, aangezien het door de Oekraïense ambassadeur in Zuid-Korea werd verspreid als echt beeld.

Cheapfakes: temporele/ruimtelijke decontextualisatie (32 beelden)

De meeste oude beelden of beelden van andere plekken waarvan wordt beweerd dat het om (bepaalde delen van) de oorlog in Oekraïne gaat, zijn van militaire voertuigen of explosies. Een strandvideo met een explosie op de achtergrond is van een ontmijningsoperatie (geen aanval van Oekraïense verzetsstrijders), het Duitse nieuwskanaal Bild liet bij een uitzending over de oorlog per ongeluk beelden zien van een Chinese gasexplosie uit 2015, twee video’s van explosies zijn ouder dan beweerd, het Oekraïense leger gebruikte een foto uit 2015 ter illustratie van nieuws dat een vliegtuig was neergehaald, een foto van een brandend gebouw is van een Israëlische aanval op Libanon, een brandende hangar in Letland is in werkelijkheid een Russische fabriek en een video van een explosie toont een Russische aanval op de Oekraïense stad Dnipro (en geen Amerikaanse aanval in 2024).

Twee video’s die het begin van de Russische invasie in 2022 zouden tonen, stammen uit 2014 en 2020, een video met tanks laat niet het Oekraïense Koersk-offensief uit 2024 zien, maar is gemaakt in 2022, beelden van tanks die Rusland vernietigd zou hebben, komen uit Denemarken en Syrië, een satellietbeeld dat moet bewijzen dat Russische vliegtuigen na een Oekraïense aanval nog heel zijn, is een maand voor die aanval genomen en een video van een zogenaamde voorbereiding van het Poolse leger om deel te gaan nemen aan de oorlog toont in werkelijkheid een jaarlijkse herdenking van de oudste Braziliaanse cavalerie-eenheid uit 2018.

Andere propagandabeelden focussen meer op groepen mensen: een video van een Oekraïense soldaat die een vrouw en haar kind zou bedreigen, is in Rusland geschoten, een video waarin Oekraïners Russische troepen verwelkomen, toont Russische soldaten die door Russen uitgewuifd worden en twee zogenaamde video’s van het Koersk-offensief in 2024 zijn gemaakt in 2023. Een foto waarop de Canadese ex-generaal Trevor Cadieu in Oekraïne gearresteerd zou worden, is oud en toont alleen andere soldaten die gevangen genomen worden, een Russische dienstweigeraar die zich in een koelkast verstopt, is eigenlijk een voortvluchtige voor een deurwaarder uit 2015 en een Russische mars met oude wapens is een oefening voor de Russische Dag van de Overwinning uit 2020.

Daarnaast zien we ook wat specifiekere narratieven: een video van kinderen van een militaire middelbare school onderweg naar een routineschietoefening en een foto van meisjes die gesneuvelde oud-studenten herdenken, moeten bewijzen dat Oekraïne kinderen inzet als soldaten. Voorts worden beelden van soldaten uit 2018, een video van bewegende lijkzakken bij een klimaatprotest in Wenen en een video van een anti-oorlogprotest in IJsland gebruikt als ‘bewijs’ dat Oekraïne de oorlog in scène zet.

Verder gebruikt Rusland geen mobiele crematoria om burgerdoden te verbranden en zijn beelden die dit moeten aantonen afkomstig van een demonstratievideo uit 2013. Ook zijn foto’s waarin Russen Oekraïense geschiedenisboeken verbranden van een pro-Russische demonstratie op de Krim uit 2010 en niet van de oorlog en zijn deze in beslag genomen Russische mobieltjes in werkelijkheid een kunstwerk uit Belarus. In een groot verzamelartikel van de VRT zien we verder beelden van een Palestijnse activiste die wordt gepresenteerd als Oekraïense verzetsheldin, een Molotovcocktail die niet explodeerde tijdens de oorlog maar tijdens Oekraïense anti-regeringsprotesten in 2014 en een invasie die eigenlijk een militaire trainingsoefening uit 2018 is.

Cheapfakes: fictieve decontextualisatie (12 beelden)

Cheapfakes die in de categorie fictieve decontextualisatie vallen, bestaan bij de oorlog in Oekraïne vooral uit beelden van filmsets. Die moeten bewijzen dat de oorlog nep is: we kwamen factchecks tegen over beelden van opnames van de korte film Nadija uit Letland, opnames van de sciencefictionfilm Invasion Planet Earth uit Birmingham in het Verenigd Koninkrijk, opnames van de Oekraïense tv-serie Contamin en opnames van de documentaire Область Героїв (‘Regio van Helden’), die weliswaar over de oorlog gaat, maar geen beelden in scène zet.

Daarnaast zijn er beelden uit videospelletjes waarvan wordt gedaan alsof het echte oorlogsbeelden zijn. Een video van een vliegbasis komt uit het spel Arma 3, een video van de mysterieuze piloot ‘Ghost of Kyiv’, waar veel over te doen was aan het begin van de oorlog, komt uit het simulatiespel Digital Combat Simulator en een derde video stamt eveneens uit Arma 3.

De overige fictieve beelden komen uit verscheidene bronnen: beeld van een jongetje uit de Oekraïense separatistische regio Donetsk dat op zoek zou zijn naar zijn dode moeder en beelden met een lijk dat een sigaret opsteekt komen uit (behind the scenes opnames van) muziekvideo’s. Een foto van een huilend jongetje verspreid door een Oekraïens parlementslid komt van de kaft van het boek El Hombre en el Ovido, een video met nazivlaggen in een Oekraïense stad komt uit de Franse oorlogsfilm Victor Young Perez, een video van een russische raketaanval is van digitale makelij, gemaakt door een visual-effects artist en een video van Zelensky die het Oekraïense parlement met machinegeweren beschiet is satire uit zijn dagen als komiek, geen bewuste oorlogspropaganda.

Cheapfakes: actor decontextualisatie (6 beelden)

We vonden zeven beelden waarbij mensen met de oorlog in Oekraïne in verband worden gebracht, terwijl zij er niets mee te maken hebben. Vier van de beelden tonen vermeende slachtoffers van de oorlog: een foto van een vermoorde journalist van de Amerikaanse nieuwszender CNN is in werkelijkheid van YouTuber Jordie Jordan, een zingend Oekraïens meisje raakte gewond toen ze van haar fiets viel (en niet door de oorlog), een Russisch meisje dat als levend schild gebruikt zou worden is in werkelijkheid een Roma-meisje dat aan een schandpaal is gehangen en een foto van een vrouw die haar kat terugvindt in het puin is in 2011 genomen in Missouri.

Twee van de beelden zouden soldaten in de oorlog tonen: iemand die wordt gepresenteerd als een zwaarlijvige Russische generaal-majoor is een grenswachter en een huilende Oekraïense soldaat is een Britse parachutist die de baret van zijn gesneuvelde broer ontving.

Cheapfakes: bewerkte beelden (19 beelden)

Van beelden die wel bewerkt zijn maar (waarschijnlijk) niet met AI vonden we drie voorbeelden die gaan om vervalste documenten. Een regeringsdocument dat in 2022 beweerde dat Rusland 40 procent van Oekraïne had bezet en meer dan 75 procent van de Oekraïense strijdkrachten is vernietigd, is vervalst en hetzelfde geldt voor een document waarin staat dat Oekraïne de dienstplicht voor vrouwen invoert. Het derde document betreft een niet-bestaande postzegel die zou zijn uitgegeven ter ere van Waffen-SS-soldaat Yaroslavl Hunka.

Dat laatste bericht over de postzegel, een bewerkte foto van een Russisch trouwfeest waar de gasten een Hitlergroet brengen en een Oekraïense vlag in is gefotoshopt en het eerdergenoemde bericht dat een straat in Oekraïne vol zou hangen met nazi-vlaggen, spelen in op het narratief dat Oekraïne een fascistisch en nazistisch land zou zijn. Dat is een narratief dat de Russische president Poetin aan het begin van de oorlog gebruikte als rechtvaardiging om Oekraïne binnen te vallen en dat bijvoorbeeld ook terugkomt in de desinformatiecampagne tegen president Zelensky. Aan de andere kant zijn aan een filmpje waarin Poetin de Europeanen zogenaamd satanistische nazi’s noemt, nep-audio en nep-ondertiteling toegevoegd.

Daarnaast worden video’s en foto’s gefabriceerd in de stijl van gevestigde media, waarschijnlijk om het nepnieuws meer kracht bij te zetten. Hier vonden we vier voorbeelden van: een nep-reportage van het Qatarese Al Jazeera waarin Oekraïense supporters op het WK Voetbal 2022 allerlei nazistische uitingen doen, een zogenaamde BBC-video die suggereert dat Oekraïne verantwoordelijk is voor een dodelijke raketaanval op een treinstation, een gemanipuleerde afbeelding die zou bewijzen dat een Italiaanse nieuwszender beelden uit een film gebruikt in berichtgeving over de oorlog, en een nepafbeelding van een Facebookpost waarin RTL Nieuws oud filmbeeld gebruikt ter illustratie bij een bericht over de oorlog.

Verder was een foto waarin Oekraïners de Amerikaanse vicepresident J.D. Vance ironisch bedanken voor de verwoesting in het land oorspronkelijk een foto van twee Russische soldaten die een vlag vasthouden, is aan een video van een vermeend schietincident in Kiev nep-audio toegevoegd, zijn aan een fragment van een Russische talkshow nep-ondertitels toegevoegd over angst voor mobilisatie, is een spottende lasershow van Russische soldaten toegevoegd aan een oud filmpje van voor de oorlog, is een foto van de Oekraïense politicus Ruslan Stefanchuk bewerkt om hem lelijker te maken, is een foto van Europa waarin in Oekraïne alle licht is uitgevallen bewerkt, zijn teksten op matrixborden boven de controversiële Krimbrug die autorijders welkom heten in Oekraïne in een oude foto geplakt, is een foto van een ebay-listing voor gebruikte Russische tanks gefotoshopt met een afbeelding uit 2010, zijn boilerhuizen van Coca-Cola en het Rode Kruis met photoshop omgedoopt tot mortuaria en is een cover van het magazine Time, waarin Poetin voorgesteld wordt als Hitler, vervalst.

Enscenering en misleidende tekst (8 beelden)

Bij enscenering is sprake van beelden die doelbewust in scène zijn gezet om te fungeren als oorlogspropaganda. Beelden zijn daarbij niet met AI gegenereerd, uit de context gehaald of bewerkt met andere software. Drie van de voorbeelden die we hiervan vonden, komen uit dit verzamelartikel van de VRT: een burgerslachtoffer met verloren voet maakt in werkelijkheid gebruik van een voetprothese, een groot pro-Russisch volksfeest in de Oekraïense oblast Donetsk bestaat maar uit een klein groepje mensen dat een mediastunt uitvoert en beelden van een aanslag zijn in scène gezet met lichaamsdelen van een lijkschouwing en gaten in een auto die er te regelmatig uitzien. Twee andere voorbeelden zijn video’s waaruit moet blijken dat Oekraïne systematisch mensen met het Syndroom van Down rekruteert, maar die waarschijnlijk door Russen in scène gezet zijn.

Bij beelden met misleidende tekst zijn de beelden echt en hebben ze te maken met de oorlog in Oekraïne, maar suggereert de bijbehorende tekst een onjuiste context. Hier vonden we ook drie voorbeelden van. In een foto van een gecrashte helikopter in Oekraïne zien sommige mensen een wasmachine in de brokstukken, wat tot veel online speculatie leidde in 2022. Het ging om een onderdeel van de gevechtshelikopter. Verder staat er geen hakenkruis op de armband van een Oekraïense generaal, maar een Noors symbool. Ook zijn er geen aanwijzingen dat de generaal in kwestie een rechtsextremistische ideologie aanhangt. En Oekraïense kinderen die de hymne van de Luftwaffe zouden zingen, zingen in werkelijkheid het Bretonse volkslied Son ar chistr (de melodie daarvan is ook gebruikt voor het Nederlandse drink- en strijdlied Zeven dagen lang).

Beelden die vallen binnen de categorieën enscenering en misleidende tekst vonden we alleen terug in de context van de oorlog tussen Oekraïne en Rusland, niet bij de oorlog in Gaza of de twee oorlogen in Iran.

Echte beelden afgedaan als nep (13 beelden)

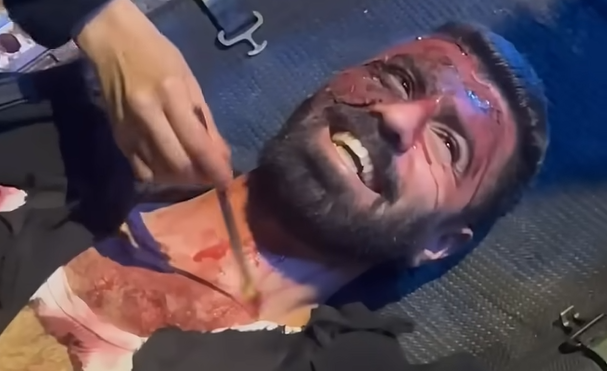

Beelden in gelinkte artikelen tonen ernstige verwondingen en kunnen als schokkend worden ervaren.

Van de veertien echte oorlogsbeelden waarvan wordt beweerd dat ze nep zijn, gaat het in drie van de gevallen om nieuwsmedia die ervan beschuldigd worden de oorlog in scène te zetten. CNN zou beelden van een brand in Canada gebruikt hebben bij een verslag van een explosie in de Oekraïense stad Lviv, meerdere nieuwsmedia zouden beelden van een Russische gasexplosie uit 2018 hebben gebruikt bij verslaggeving aan het begin van de oorlog en de BBC zou zijn liveverslaggeving van de oorlog in scène zetten met als bewijs een authentieke, maar uit de context gehaalde foto.

Twee foto’s van jongens die in de oorlog hun ouders verloren, zouden volgens online berichten oude beelden recyclen of een crisisacteur tonen die vele begrafenissen bezoekt, steeds met een andere foto van een andere gesneuvelde vader. Maar de eerste foto stamt wel uit de oorlog en de tweede jongen bezocht simpelweg meerdere afscheidsceremonies voor gesneuvelde soldaten in zijn regio. Verder is een foto van vluchtelingen niet genomen in Syrië, maar in Oekraïne, is een video van een vrouw die gewond raakt bij beschietingen in Kiev ook niet nep en is deze foto van een zwangere vrouw die omkwam bij een bombardement in de stad Krementsjoek ook echt. Een foto van NAVO-baas Mark Rutte was wel genomen in Oekraïne en een video van Poetin die stewardessen ontmoet, is niet vervalst: dat Poetins hand dwars door een microfoon lijkt te gaan, is een optische illusie.

In de laatste vier gevallen wordt gedaan alsof foto’s van verwoesting en gebeurtenissen nep zijn: op echte beelden die genomen zijn in Boetsja na het bloedbad dat Russische soldaten daar aanrichtten, zijn geen bewegende lichamen te zien, een before/after-filmpje bewijst niet dat de infrastructuur van Oekraïne onbeschadigd is, maar toont het resultaat van heropbouw, beweringen dat beelden van een gebombardeerd winkelcentrum in Krementsjoek vervalst zijn, kloppen niet en een foto van zwaarbeschadigde auto’s met intacte ramen bewijst niet dat die verwoesting in scène is gezet.

Gaza-oorlog

Alhoewel er al decennia lang conflict is tussen Israël en Palestina, waar de Gazastrook en de Westelijke Jordaanoever deel van uitmaken, kwam het geweld in Gaza van Israëlische zijde eind 2023 in een stroomversnelling nadat Hamas het land aanviel. Over deze oorlog, die bijna tweeënhalf jaar bezig is, vonden we 52 artikelen met in totaal 87 beelden.

AI-gegenereerde beelden (27 beelden)

Bij de oorlog in Gaza is er tot nu toe vaker sprake van AI-gegenereerd beeld dan bij de oorlog in Oekraïne. Een aantal foto’s van slachtoffers aan beide zijden van het conflict zijn gemaakt met AI: deze foto van een man met vijf kinderen die door de ruïnes van Gaza trekt, een foto van een Israëlische soldaat die haar benen verloren zou hebben in Gaza (en voldoet aan de kenmerken van AI-slop op Facebook) en meerdere foto’s van een artsengezin dat hun negen kinderen in de oorlog verloor, alhoewel het achterliggende nieuws in dat geval wel echt is. Ook foto’s van Palestijnse kinderen die hun kat in het puin terugvinden en foto’s van Israëlische speurhonden zijn gemaakt met AI.

In de zomer van 2025 constateerde Amnesty International dat er in Gaza hongersnood heerst door een uithongeringscampagne van Israël, en daarvoor waren er al zorgen over honger in Gaza, omdat Israël bijvoorbeeld steeds minder voedselhulp toeliet in de regio. Een enkel nepbeeld van een zwaarlijvig meisje moet ontkrachten dat de hongersnood bestaat, maar de meeste AI-beelden tonen eerder nep-voedselhulp: een fles uit Egypte met voedsel die naar Gaza moet drijven (waar wel een echt verhaal achter schuilgaat), een video van een hulpkonvooi dat Gaza zou naderen en meerdere video’s van Chinese vliegtuigen die voedsel zouden droppen in Gaza.

Overige AI-beelden over de oorlog in Gaza zijn een nepbeeld van een mars van activisten uit Maghreb-landen richting Caïro (hoewel de mars wel echt heeft plaatsgevonden) en een serie video’s die zware sneeuwval in de regio tonen om geld in te zamelen voor Gaza of om te beweren dat de situatie in Gaza erger voorgesteld wordt dan ze daadwerkelijk is.

Cheapfakes: temporele/ruimtelijke decontextualisatie (30 beelden)

Qua oude beelden en beelden van andere plaatsen, zijn er ook bij de oorlog in Gaza voorbeelden van beelden van gebeurtenissen en vermeend geweld die uit hun context zijn gehaald. Een video van een Israëlische bulldozer die een weg vernietigt in de Palestijnse gebieden is uit 2021 en genomen in de Westelijke Jordaanoever, een video van rode vuurpijlen die een stad verlichten is in werkelijkheid van een feest in Algiers, een andere video die wel bombardementen toont is genomen in Soedan, een tweede video van bombardementen is genomen in 2022, twee foto’s die een Hamaskantoor zouden tonen, laten in werkelijkheid een gebouw van een Qatarese hulporganizatie in Gaza-stad zien en een video die zou laten zien dat het Israëlische leger op Israëlische burgers schiet bij een muziekfestival op 7 oktober 2023 laat Hamasleden zien die terugkeren naar de Gazastrook.

Verder zijn er ook meerdere beelden waarvan beweerd wordt dat ze van de Israëlische inval van het Al Shifa-ziekenhuis zijn, maar het gaat om een oude video uit een ander land (Egypte, 2013), om beelden van het ziekenhuis van voor de inval en om een bombardement dicht bij een ander ziekenhuis. Twee laatste beelden uit een verzamelartikel van de VRT hebben niets te maken met de oorlog die op 7 oktober 2023 uitbrak: ze tonen mensen die in 2021 naar de Libanees-Israëlische grens trekken en parachutisten bij een militaire universiteit in Egypte.

Slachtoffers van andere of eerdere conflicten worden ook betrokken bij de oorlog in Gaza om het leed van de oorlog te benadrukken. Een video van een Palestijns weeskind is van voor de oorlog, een video van een huilende jongen wiens zus is omgekomen, komt uit Syrië en is geschoten in 2014, een foto van een dode baby komt uit Libanon en is genomen in 2006 en een foto met twee lichamen omgeven door modder is van een overstroming in Jemen. Verder is deze foto van etenswaren die in bloed liggen genomen na een aanslag in Syrië en zijn beelden van een Teletubbie-pop met explosieven erin op zijn laatst gemaakt in 2018 en waarschijnlijk in Jemen.

De overige beelden van andere tijden en plaatsen hebben te maken met de hongersnood in Gaza en de hulp die daarvoor wordt gegeven. Een van de video’s die Chinese voedselhulp aan Gaza zou tonen is oud beeld uit 2024, een video die weggegooide voedselhulp zou tonen is in 2016 in Saoedi-Arabië gemaakt, beelden van Egyptenaren die voedselhulp brengen zijn in werkelijkheid van mensen die tassen met sigaretten dragen bij de Libische grens, een video van gekaapte voedselhulp die in de zomer van 2025 rondging, werd al gemaakt in 2023 (en het is onduidelijk wat er met het voedsel gebeurt), een video met vrachtwagens die aan de Gazaanse grens geblokkeerd worden stamt uit 2021, een video van vissers die weer kunnen vissen door een hulpkonvooi, is ouder dan nieuws van het konvooi en een andere video toont een hulpkonvooi uit Tunesië.

Cheapfakes: fictieve decontextualisatie (7 beelden)

Veel van de beelden binnen deze categorie zijn, net zoals bij de oorlog in Oekraïne, beelden van filmsets of films die worden gepresenteerd als geënsceneerde oorlogspropaganda. Het gaat hierbij om beelden van een Palestijnse jongen die wordt aangekleed als oorlogsslachtoffer in het kader van een artistiek project in Irak, een video van een jong meisje met nepbloed uit opnames in Libanon voor de korte film The Reality, opnames van de korte Paletijnse film Empty place en opnames van de tv-serie Bleeding Dust.

Twee van de overige drie beelden betreffen satire: een man sloot peuters uit zijn familie op in een kippenhok als grap en een Israëlische influencer deed in een satirische reportage alsof een hulpkonvooi voor Palestina vol zat met condoomverpakkingen en drugs. Het laatste fictieve beeld betreft oorlogsbeeld uit het videospel Arma 3.

Cheapfakes: actor decontextualisatie (5 beelden)

Vijf beelden brengen mensen in verband met de Gaza-oorlog die daar niets mee te maken hebben. Twee video’s van vermeende neplijken uit Gaza zijn in werkelijkheid van een studentendemonstratie in Caïro uit 2013 en een demonstratie tegen een COVID-lockdown uit 2020 en een derde video van zogenaamde neplijken toont een opleiding voor begrafenismanagement uit Maleisië. Verder laat een vermeende video van een Israëlisch meisje dat levend verbrand wordt een lynchpartij zien in Guatemala en de laatste foto toont een zwaarlijvige man die het bestaan van de hongersnood in Gaza moet ontkrachten. De man is een IS-strijder die in 2020 in Irak is gearresteerd.

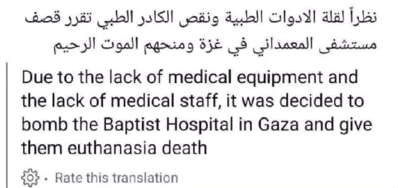

Cheapfakes: bewerkte beelden (2 beelden)

Twee beelden die we tegenkwamen over de oorlog in Gaza waren bewerkt zonder AI: een Facebookpost, zogenaamd van het Israëlische leger, waarin staat dat het Israëlische leger heeft besloten om een ziekenhuis aan te vallen, en een video van een arrestatie met vervalste ondertiteling, waarin Israëlische politieagenten een Arabisch-Israëlische vrouw zouden deporteren.

Echte beelden afgedaan als nep (16 beelden)

Beelden in gelinkte artikelen tonen ernstige uithongering en kunnen als schokkend worden ervaren.

De categorie van echte beelden die als nep worden afgedaan, is bij de oorlog in Gaza extra relevant vanwege de complottheorie over ‘Pallywood’ (Palestine + Hollywood). Het idee hierachter is dat Hamas en Palestijnen geweld en hongersnood in de Palestijnse gebieden in scène zetten om oorlogspropaganda tegen Israël te produceren. Hoewel deze complottheorie al bestond voor 7 oktober 2023, werd er na die datum veelvuldig over gesproken. De theorie wordt ook verspreid door Israëlische overheidsaccounts.

De grootste verzameling beelden in deze categorie betreft uitgehongerde Palestijnen. Er wordt beweerd dat foto’s van een ondervoede jongen en een ondervoede baby in Jemen genomen zijn, een foto van een Gazaans meisje dat om voedsel smeekt zou een Jezidisch meisje tonen en in een verzamelartikel van de VRT worden vier beelden van drie verschillende ondervoede Palestijnse jongens besproken waarvan wordt beweerd dat ze in Jemen gemaakt zijn of dat de magere kinderen onderliggende ziektes hebben.

Bij twee beelden worden slachtoffers van de oorlog afgedaan als crisisacteurs: een man zou op het ene moment op een ziekenhuisbed liggen en op het andere weer filmend rondlopen (het gaat om twee verschillende mannen), twee video’s zouden bewijzen dat twee vrouwelijke burgerslachtoffers eigenlijk Hamasstrijders zijn en van een Palestijnse jongen die omkwam bij Israëlische bombardementen wordt beweerd dat het een pop is. Beelden van een aanval op het Al-Aqsa ziekenhuis in Gaza en van hulpverlening onder Gazanen zijn eveneens niet in scène gezet of bewerkt met AI. Ook wordt bij twee beelden van journalisten ten onrechte gezegd dat ze geënsceneerd zijn, specifiek een BBC-reportage en een foto van fotograaf Anas Zayed Fteiha.

Twaalfdaagse Oorlog en Iranoorlog 2026

Het afgelopen jaar zijn er in Iran twee oorlogen geweest: de Twaalfdaagse Oorlog met Israël in de zomer van 2025 en de oorlog met de Verenigde Staten en Israël die begon op 28 februari 2026 en op 8 april pauzeerde door een precaire wapenstilstand. Over beide oorlogen vonden we in totaal 36 artikelen waarin 64 beelden gefactcheckt werden.

AI-gegenereerde beelden (32 beelden)

Beelden in gelinkte artikelen tonen ernstige verwondingen en kunnen als schokkend worden ervaren.

Bij de oorlogen in Iran zagen we veel AI-beelden terug, waarvan de meeste explosies en andere verwoesting afbeelden. Een video van Iraanse raketinslagen in Israël is met AI gemaakt, net als drie clips van Israëlische bombardementen in Iran tijdens de Twaalfdaagse Oorlog. Een korte video van een ontploffing van de Evin-gevangenis in Teheran is nep en beelden van een brandend gebouw in de Israëlische staf Haifa eveneens. In een overzichtsartikel van de NOS vinden we ook twee AI-beelden van explosies. Daarnaast komen ook satellietbeelden van een verwoeste Amerikaanse legerbasis en twee beelden van verwoeste Amerikaanse ambassades uit de koker van AI-modellen.

Verder vonden we zeven AI-gegenereerde beelden van verwoeste vliegtuigen: een video van schade aan een Amerikaanse B-2-bommenwerper, een reeks van vier foto’s van Iraanse soldaten die B-2-bommenwerpers hebben neergehaald, twee foto’s van neergehaalde F-35 vliegtuigen en een video van een Amerikaanse bommenwerper op een Iraanse oplegger.

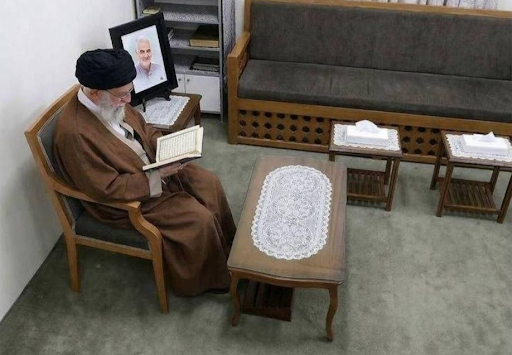

Sommmige AI-video’s laten (vermeende) bekende en onbekende slachtoffers zien. Er gaat een video rond van de Israëlische premier Benjamin Netanyahu die onder het puin wordt weggehaald, een foto van een zwaargewonde ayatollah Mojtaba Khamenei in het ziekenhuis en een nepafbeelding van de slachtoffers van het bombardement op een meisjesschool in Iran. Ook worden soldaten in beeld gebracht: VRT identificeerde als AI beelden van huilende Amerikaanse en Israëlische soldaten die om hun ouders roepen, van Oekraïense soldaten die naar de Golfregio zijn gestuurd, een foto van tien Amerikaanse soldaten die gevangen zijn genomen door Iraniërs en soldaten die kijkers uitnodigen om naar Iran te komen.

Ook vonden we factchecks met twee overige AI-gegenereerde beelden: een nepkaart van de omgeving rond een Israëlisch ziekenhuis waar Iraanse raketten zouden zijn neergekomen en een video van een menigte in Iran die pro-Netanyahu leuzen zou zingen.

Cheapfakes: temporele/ruimtelijke decontextualisatie (20 beelden)

De meeste video’s van andere conflicten en andere plaatsen waarvan wordt gedaan alsof ze van de oorlogen in Iran zijn, laten explosief of ander grootschalig geweld zien. De beelden die gefactcheckt zijn door Nederlandse en Vlaamse factcheckers betreffen een Oekraïense aanval op een Russisch munitiedepot, een Israëlisch bombardement op Syrië uit 2024, een Iraanse raketaanval op Israël uit 2024, een brand in een industriegebied in Dubai uit 2025, een brand in een woontoren in de Verenigde Arabische Emiraten, een brand in de Filipijnen, een aanval op een Israëlische luchtmachtbasis uit 2024 (die ook als nepbeeld werd ingezet tijdens de Twaalfdaagse Oorlog) en een video die al online stond voor de aanval op een Amerikaanse ambassade die in dezelfde video te zien zou zijn. Verder was ook sprake van een video van een aanval op Teheran tijdens de Twaalfdaagse Oorlog (waarvan werd gedaan alsof hij was van de Iranoorlog van 2026) en idem dito voor twee video’s van een aanval op Tel Aviv.

Qua foto’s en video’s van mensen of groepen mensen hebben we een beeld van de Iraanse buitenlandminister Abbas Araghchi die huilt om majoor-generaal Hossein Salami uit de Twaalfdaagse Oorlog (en niet uit de Iranoorlog van 2026), een video van Iraanse meisjes die in 2022 protesteerden, een video van een Koerdische feestviering die geen protest tegen het Iraanse regime toont, een video van Iraniërs die het Perzische nieuwjaar vieren, Iraniërs die in de file staan en een video uit 2017 die eveneens geen protest toont en een video van een politieoperatie uit 2025.

Cheapfakes: fictieve decontextualisatie (6 beelden)

Bijna alle fictieve beelden van de twee Iranoorlogen komen uit videospelletjes: twee beelden uit War Thunder, twee andere beelden uit Arma 3 en World of Warships en een laatste beeld uit een niet nader gespecificeerde militaire simulator. Het laatste beeld is een 3D-simulatie van een militaire basis onder een Israëlisch ziekenhuis die uit een satirische video komt.

Cheapfakes: actor decontextualisatie (1 beeld)

Het enige beeld van de Iranoorlog uit 2026 van iemand die niets met de oorlog te maken heeft, maar er wel bij betrokken wordt, is van een Chileense piloot die eigenlijk een Israëlische piloot zou zijn die gevangengenomen is door Iran.

Cheapfakes: bewerkte beelden (2 beelden)

De twee bewerkte beelden van de Iranoorlog uit 2026 zijn een foto van de zogenaamde laatste momenten van ayatollah Ali Khamenei die bewerkt is en gebaseerd is op foto’s uit 2023 en een video uit Teheran waarin feest gevierd wordt en een Israëlische vlag op een gebouw wordt geprojecteerd die achteraf is toegevoegd.

Echte beelden afgedaan als nep (3 beelden)

De drie echte beelden die werden afgedaan als nep in de Iranoorlog van 2026 zijn allemaal van Benjamin Netanyahu. Eind maart ging het gerucht dat de premier was omgekomen in de oorlog en drie video’s van officiële Israëlische accounts op X die het tegendeel moesten bewijzen, werden weggewuifd als AI.

Hoe worden nepbeelden gemaakt?

Met de data van nepbeelden die verspreid werden in het kader van de oorlogen in Oekraïne, Gaza en Iran, kunnen we zien hoe de opmaak van die nepbeelden zich de afgelopen vier jaar ontwikkeld heeft. De selectie is niet alomvattend, omdat alleen nepbeelden verzameld zijn die door Nederlandse en Vlaamse factcheckers gecheckt zijn, maar kan wel een beeld geven. Wat ten eerste opvalt is dat de verdeling tussen echte beelden die als nep worden afgedaan en beelden die gebruikt worden om nepnieuws te verspreiden sinds 2022 min of meer hetzelfde is gebleven: ongeveer tien tot twintig procent van de beelden zijn echt.

Daarnaast kunnen we ook kijken naar hoe vaak specifiek elke categorie nepbeeld voorkomt en hoe dat door de tijd heen veranderd is.

Wat hier voornamelijk opvalt is het aandeel cheapfakes tegenover het aandeel AI-gegenereerde afbeeldingen. Waar AI-beelden bij de oorlog in Oekraïne nog maar een klein aandeel vormen van ongeveer vijftien procent, was bij de oorlogen in Iran de helft van het nepbeeld met AI gemaakt. Dat zal deels komen doordat er minder nepbeeld was bij de oorlogen in Iran omdat deze recenter zijn, maar ook bij de oorlog in Gaza (38% AI-beelden) zien we een toename ten opzichte van de oorlog in Oekraïne. Die toename is vooral ten koste gegaan van beelden die met andere middelen bewerkt werden en het aandeel van de verschillende soorten gedecontextualiseerde beelden is min of meer gelijk gebleven (behalve actor-decontextualisatie).

Dat er bij de Iranoorlog in 2026 veel AI-beelden gebruikt worden, werd in de media ook geconstateerd. Het feit dat er in Iran sprake is van een internetblokkade maakt het daarnaast ook lastiger dan normaal om beelden te verifiëren. Persbureau ANP moest in maart 2026 bijvoorbeeld duizend beelden uit zijn beeldbank verwijderen omdat ze met AI gemanipuleerd waren. De explosie is op zich ook logisch, omdat toen de oorlogen in Oekraïne en Gaza begonnen, de technologie nog in de kinderschoenen stond en AI-afbeeldingen er nog veel primitiever uitzagen dan anno 2026.

Daarmee kunnen we concreter een vraag beantwoorden die we drie jaar geleden ook stelden: waarin schuilt het gevaar van deepfakes? Destijds waren cheapfakes de voornaamste vorm van desinformatie, zoals Michael Hameleers aangeeft in zijn onderzoek uit 2025 [pdf]. Maar AI heeft de afgelopen paar jaar een steeds prominentere plaats ingenomen in het desinformatielandschap rond oorlogen, maar niet op de manier waar rond 2023 vooral voor gevreesd werd: filmpjes van politici die alles in de mond gelegd kan worden. In plaats daarvan lijken moderne deepfakes veel meer op de cheapfakes van nu en weleer. Er worden vooral raketinslagen, slachtoffers en neergeschoten voertuigen verzonnen die veel weg hebben van oude beelden of beelden van andere conflicten. AI wordt daarnaast ook ingezet om humoristischere propaganda te verspreiden, wat soms beter aan kan slaan dan een traditionele speech.

Oorsprong en verspreiding

Het ligt voor de hand dat in tijden van oorlog regeringen van de vechtende landen desinformatie verspreiden als deel van propagandacampagnes. Hameleers schreef dat beelden vaak worden gebruikt voor het verheerlijken van de eigen zijde, het zwartmaken van de andere zijde of om de schaal van het conflict te overdrijven. In de verzameling van beelden die door Nederlandstalige factcheckers zijn gecheckt, kwamen we hier en daar ook specifiekere narratieven tegen. Bij de oorlog in Oekraïne werden Oekraïeners er soms van beschuldigd nazi’s te zijn, wat de Russische invasie moet rechtvaardigen en wat ook vaak terugkwam in de desinformatiecampagne tegen Zelensky. Een andere bewering die vaker gedaan werd was dat Oekraïne kindsoldaten inzet in de oorlog, een manier van de vijand zwart te maken. Bij de oorlog in Gaza werd vaak ingespeeld op de Pallywood-complottheorie, waarbij wordt beweerd dat Palestijnse slachtoffers van oorlog en hongersnood eigenlijk acteurs zijn. Dit soort beweringen werd ook gedaan tijdens de oorlog in Oekraïne, maar niet zo prominent als bij Gaza.

Om een beeld te krijgen van wanneer (nep)beelden verspreid worden, hebben we sinds het begin van de oorlogen Oekraïne, Gaza en Iran per maand op een rij gezet hoeveel factchecks gepubliceerd zijn. Daaruit blijkt dat in de eerste maand of eerste maanden van een oorlog het meeste gefactcheckt wordt en waarschijnlijk ook de meeste (nep)beelden rondgaan, waarna het aantal factchecks per maand meestal drastisch afneemt. Een uitzondering hierop vormt het aantal factchecks over de oorlog in Gaza medio 2025, wat waarschijnlijk samenhangt met nieuws over hongersnood in de regio rond die tijd.

De motieven om nepbeelden te verspreiden, zijn niet altijd politiek. Soms gaat het om pure commercie, zoals bijvoorbeeld in het geval van Vietnamese bedrijven die AI gebruiken om nep- en pulpnieuws op Facebook te verspreiden. Qua oorlogsbeelden kwamen we een aantal tegen die trekken hebben van de typische AI-slop die veel op Facebook en andere sociale media rondgaat. In die gevallen worden oorlogen waarschijnlijk ingezet om geld te verdienen.

Als het motief wel politiek is, kunnen regeringen zelf nepbeelden verspreiden, of in het geval van AI-beelden die inspelen op memes, anderen inhuren zoals mediabedrijf Explosive Media dat op X actief is. In andere gevallen kan ‘de gewone man’ ook nepbeelden over oorlog verspreiden, waar onderzoek naar gedaan is [pdf], specifiek in de context van de oorlog tussen Armenië en Azerbeidzjan in 2020. Mensen kunnen kiezen om propaganda te verspreiden om verschillende redenen, bijvoorbeeld omdat ze het eens zijn met de boodschap of uit het cynische idee dat alles toch nepnieuws is. Manipulatie door regeringen speelt daarin ook een rol. Er wordt dan gebruikgemaakt van sjablonen die veel emoties opwekken met als doel polarisatie te vergroten of zoveel informatie te genereren dat mensen de kluts kwijtraken en dat bepaald nieuws ondergesneeuwd wordt (‘flooding the zone’).

Cheapfakes zijn op dat gebied niet per se effectiever dan desinformatie die puur in tekstvorm wordt gepresenteerd volgens onderzoek van Michael Hameleers [pdf]. Dat zou bijvoorbeeld kunnen komen doordat de tekst de voornaamste bron is van de framing van een verhaal, terwijl beelden voor emotie zorgen. Of het zou kunnen dat de credibiliteit van video’s in het bijzonder door meer wordt bepaald dan de waargenomen authenticiteit of het realisme van de onderliggende boodschap.

Wel maken cheapfakes en andere nepbeelden deel uit van het zogenoemde ‘post-truth’ tijdperk waar vanaf 2016 van gesproken wordt. De waarheid doet er steeds minder toe en het boeit degenen die liegen ook niet zo, waardoor ze hun onwaarheden steeds openlijker verkopen. Alles is een kwestie van perspectief en niemand kan echt nog bepalen wat waar is, of wat niet. Dit begon tijdens de eerste termijn van Donald Trump als Amerikaans president en met de Brexit, toen onwaarheden werden verspreid die inspeelden op onderbuikgevoelens en de waarheid niet tegenspraken, maar eerder voorbij gingen.